Звук.

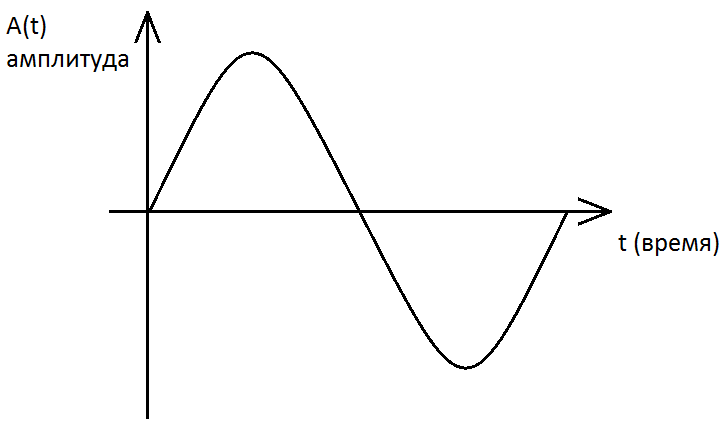

Звук – это звуковая волна, у которой непрерывно меняется амплитуда и частота. При этом амплитуда определяет громкость звука, а частота — его тон. Чем больше амплитуда звуковых колебаний, тем он громче. А частота писка комара больше частоты сигнала автомобиля. Частоту измеряют в Герцах. 1Гц — это одно колебание в секунду.

Кодирование звука.

Компьютер является мощнейшим устройством для обработки различных типов информации, в том числе и звуковой. Но аналоговый звук непригоден для обработки на компьютере, его необходимо преобразовать в цифровой. Для этого используются специальные устройства — аналого-цифровые преобразователи или АЦП. В компьютере роль АЦП выполняет звуковая карта. Каким же образом АЦП преобразует сигнал из аналогового в цифровой вид? Давайте разберемся.

Пусть у нас есть источник звука с частотой 440Гц, пусть это будет гитара. Сначала звук нужно превратить в электрический сигнал. Для этого используем микрофон. На выходе микрофона мы получим электрический сигнал с частотой 440Гц. Графически он выглядит таким образом:

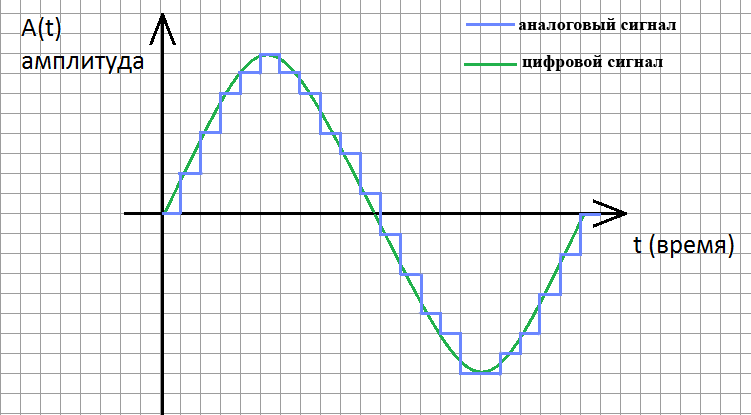

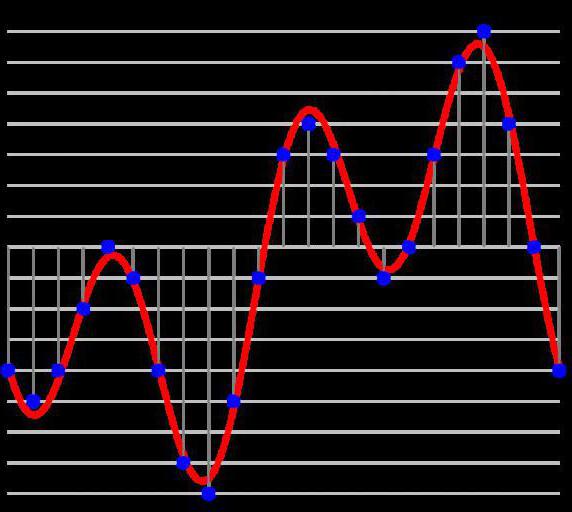

Следующая задача — преобразовать этот сигнал в цифровой вид, то есть в последовательность цифр. Для этого используется временная дискретизация — аналоговый звуковой сигнал разбивается на отдельные маленькие временные участки и для каждого такого участка устанавливается определенная величина интенсивности звука, которая зависит от амплитуды. Другими словами через какие-то промежутки времени мы измеряем уровень аналогового сигнала. Количество таких измерений за одну секунду называется частотой дискретизации. Частота дискретизации измеряется в Герцах. Соответственно, если мы будет измерять наш сигнал 100 раз в секунду, то частота дискретизации будет равна 100Гц.

Вот примеры некоторых используемых частот дискретизации звука:

- 8 000 Гц — телефон, достаточно для речи;

- 11 025 Гц;

- 16 000 Гц;

- 22 050 Гц — радио;

- 32 000 Гц;

- 44 100 Гц — используется в Audio CD;

- 48 000 Гц — DVD, DAT;

- 96 000 Гц — DVD-Audio (MLP 5.1);

- 192 000 Гц — DVD-Audio (MLP 2.0);

- 2 822 400 Гц — SACD, процесс однобитной дельта-сигма модуляции, известный как DSD — Direct Stream Digital, совместно разработан компаниями Sony и Philips;

- 5,644,800 Гц — DSD с удвоенной частотой дискретизации, однобитный Direct Stream Digital с частотой дискретизации вдвое больше, чем у SACD. Используется в некоторых профессиональных устройствах записи DSD.

Современные звуковые карты способны оцифровывать звук с частотой дискретизации 96Кгц и даже 192 кГц.

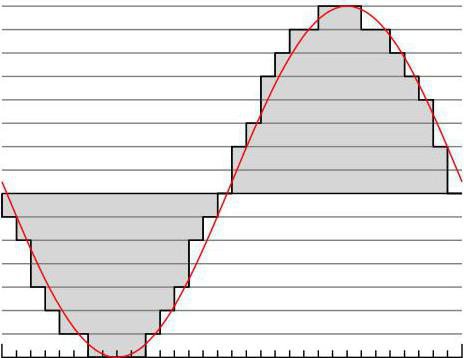

В итоге наш аналоговый сигнал превратится в цифровой, а график станет уже не гладким, а ступенчатым, дискретным:

Глубина кодирования звука — это количество возможных уровней сигнала. Другими словами глубина кодирования это точность измерения сигнала. Глубина кодирования измеряется в битах. Например, если количество возможных уровней сигнала равно 255, то глубина кодирования такого звука 8 бит. 16-битный звук уже позволяет работать с 65536 уровнями сигнала. Современные звуковые карты обеспечивают глубину кодирования в 16 и даже 24 бита, а это возможность кодирования 65536 и 16 777 216 различных уровней громкости соответственно.

Зная глубину кодирования, можно легко узнать количество уровней сигнала цифрового звука. Для этого используем формулу:

N=2i,

где N — количество уровней сигнала, а i — глубина кодирования.

Например, мы знаем, что глубина кодирования звука 16 бит. Значит количество уровней цифрового сигнала равно 216=65536.

Чтобы определить глубину кодирования если известно количество возможных уровней применяют эту же формулу. Например, если известно, что сигнал имеет 256 уровней сигнала, то глубина кодирования составит 8 бит, так как 28=256.

Как понятно из данного вышеприведенного рисунка, чем чаще мы будем измерять уровень сигнала, т.е. чем выше частота дискретизации и чем точнее мы будем его измерять, тем более график цифрового сигнала будет похож на аналоговый график, соответственно, тем выше качество цифрового звука мы получим. И тем больший объем будет иметь файл.

Кроме того, мы рассматривали монофонический (одноканальный) звук, если же звук стереофонический, то размер файла увеличивается в 2 раза, так как он содержит 2 канала.

Рассмотрим пример задачи.

Какой объем будет иметь звуковой монофонический файл содержащий звук, если длительность звука 1 минута, глубина кодирования 8 бит, а частота дискретизации 22050Гц?

Зная частоту дискретизации и длительность звука легко установить количество измерений уровня сигнала за все время. Если частота дискретизации 22050Гц — значит за 1 секунду происходит 22050 измерений, а за минуту таких измерений будет 22050*60=1 323 000.

На одно измерение требуется 8 бит памяти, следовательно на 1 323 000 измерений потребуется 1 323 000*8 = 10 584 000 бит памяти. Разделив полученное число на 8 получим объем файла в байтах — 10584000/8=1 323 000 байт. Далее, разделив полученное число на 1024 получим объем файла в килобайтах — 1 291,9921875 Кбайт. А разделив полученное число еще раз на 1024 и округлив до сотых получим размер файла в мегабайтах — 1 291,9921875/1024=1,26Мбайт.

Ответ: 1,26Мбайт.

Автор:

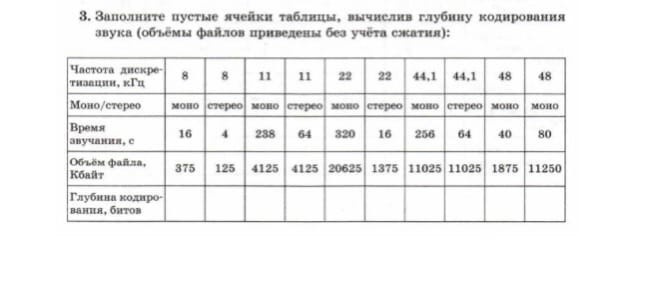

Как вычислить глубину кодирования звука?

Как вычислить глубину кодирования звука?

Если известна частота дискретизации 11кГц, моно, время звучания 238 с, объем файла 4125Кбайт.

По какой формуле?

-

Вопрос заданболее двух лет назад

-

2318 просмотров

Пригласить эксперта

1. Объем файла переводите в байты.

V1 = F * 1024

2. Делите на время звучания.

V2 = V1 / t

3. Делите на число каналов k.

V3 = V2 / k

4. Делите на частоту w.

V4 = V3 / w

5. Делите на 1000, так как частота в килогерцах.

V5 = V4 / 1000.

6. Берете целую часть.

V6 = целое(V5)

-

Показать ещё

Загружается…

25 мая 2023, в 05:14

5000 руб./за проект

25 мая 2023, в 02:38

1000 руб./за проект

25 мая 2023, в 02:31

800 руб./за проект

Минуточку внимания

Кодирование звука относится к способам сохранения и передачи аудиоданных. В приведенной ниже статье описывается, как работают такие кодировки.

Заметим, что это довольно сложная тема — «Глубина кодирования звука». Определение данного понятия также будет дано в нашей статье. Представленные в статье концепции предназначены только для общего обзора. Раскроем понятия глубины кодирования звука. Некоторые из этих справочных данных могут быть полезны для понимания того, как работает API, а также как формулировать и обрабатывать аудио в ваших приложениях.

Как найти глубину кодирования звука

Аудиоформат не эквивалентен аудиокодированию. Например, популярный формат файла, такой как WAV, определяет формат заголовка аудиофайла, но сам по себе не является кодировкой звука. WAV-аудиофайлы часто, но не всегда используют линейную кодировку PCM.

В свою очередь, FLAC является как форматом файла, так и кодировкой, что иногда приводит к некоторой путанице. В пределах Speech API FLAC глубина кодирования звука — это единственная кодировка, которая требует, чтобы аудиоданные включали заголовок. Все другие кодировки указывают беззвучные аудиоданные. Когда мы ссылаемся на FLAC в Speech API, мы всегда ссылаемся на кодек. Когда мы ссылаемся на формат файла FLAC, мы будем использовать формат «.FLAC».

Вы не обязаны указывать кодировку и частоту дискретизации для файлов WAV или FLAC. Если этот параметр опущен, API облачной речи автоматически определяет кодировку и частоту дискретизации для файлов WAV или FLAC на основе заголовка файла. Если вы укажете значение кодировки или частоты дискретизации, которое не соответствует значению в заголовке файла, API облачной речи вернет ошибку.

Глубина кодирования звука — это что такое?

Аудио состоит из осциллограмм, состоящих из интерполяции волн разных частот и амплитуд. Чтобы представить эти формы сигналов в цифровых средах, сигналы должны быть отбракованы со скоростью, которая может представлять звуки самой высокой частоты, которые вы хотите воспроизвести. Для них также необходимо хранить достаточную глубину бит для представления правильной амплитуды (громкость и мягкость) осциллограмм по образцу звука.

Способность устройства звуковой обработки воссоздавать частоты известна как его частотная характеристика, а способность создавать надлежащую громкость и мягкость известна как динамический диапазон. Вместе эти термины часто называют верностью звукового устройства. Глубина кодирования звука — это средство, с помощью которого можно восстановить звук, используя эти два основных принципа, а также возможность эффективно хранить и передавать такие данные.

Частота выборки

Звук существует как аналоговая волновая форма. Сегмент цифрового звука аппроксимирует эту аналоговую волну и сэмплирует ее амплитуду с достаточно высокой скоростью, чтобы имитировать собственные частоты волны. Частота дискретизации цифрового аудиосигнала определяет количество выборок, взятых из исходного материала аудио (в секунду). Высокая частота дискретизации увеличивает способность цифрового звука точно представлять высокие частоты.

Как следствие теоремы Найквиста-Шеннона, обычно нужно пробовать хотя бы вдвое большую частоту любой звуковой волны, которую необходимо записать в цифровом виде. Например, для представления звука в диапазоне человеческого слуха (20-20000 Гц), цифровой аудиоформат должен отображать не менее 40000 раз в секунду (что является причиной того, что звук CD использует частоту дискретизации 44100 Гц).

Бит глубины

Глубина кодирования звука — это влияние на динамический диапазон заданного образца звука. Более высокая битовая глубина позволяет представлять более точные амплитуды. Если у вас много громких и мягких звуков в одном и том же звуковом образце, вам понадобится больше бит, чтобы правильно передавать эти звуки.

Более высокие битовые глубины также уменьшают соотношение «сигнал/шум» в образцах аудио. Если глубина кодирования звука составляет 16 битов, музыкальный звук CD передается с использованием данных величин. Некоторые методы сжатия могут компенсировать меньшие битовые глубины, но они, как правило, являются потерями. DVD Audio использует 24 бит глубины, в то время как в большинстве телефонов глубина кодирования звука составляет 8 бит.

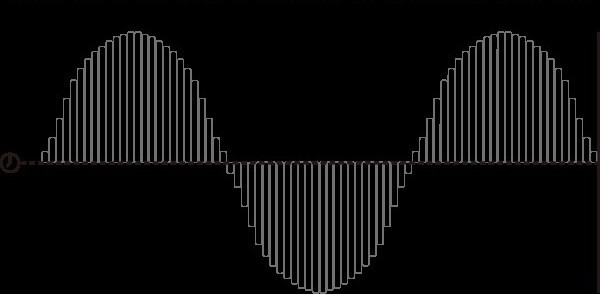

Несжатый звук

Большая часть обработки цифрового звука использует эти два метода (частоту дискретизации и глубину бит) для простого хранения аудиоданных. Одна из самых популярных технологий цифрового звука (популяризированная при использовании компакт-диска) известна как модуляция импульсного кода (или PCM). Аудио выбирается с установленными интервалами, и амплитуда дискретизированной волны в этой точке сохраняется как цифровое значение с использованием битовой глубины образца.

Линейный PCM (который указывает, что амплитудный отклик является линейно однородным по выборке) является стандартом, используемым на компакт-дисках и в кодировке LINEAR16 Speech API. Оба кодирования создают несжатый поток байтов, соответствующий непосредственно аудиоданным, и оба стандарта содержат 16 бит глубины. Линейный PCM использует частоту дискретизации 44 100 Гц на компакт-дисках, что подходит для перекомпоновки музыки. Однако частота дискретизации 16000 Гц более подходит для рекомпозиции речи.

Линейный PCM (LINEAR16) является примером несжатого звука, поскольку цифровые данные хранятся аналогичным образом. При чтении одноканального потока байтов, закодированного с использованием Linear PCM, вы можете подсчитать каждые 16 бит (2 байта) для получения другого значения амплитуды сигнала. Практически все устройства могут манипулировать такими цифровыми данными изначально — можно обрезать аудиофайлы Linear PCM с помощью текстового редактора, но несжатый звук — не самый эффективный способ транспортировки или хранения цифрового звука. По этой причине большинство аудио использует цифровые методы сжатия.

Сжатый звук

Аудиоданные, как и все данные, часто сжимаются, что облегчает их хранение и транспортировку. Сжатие в аудиокодировании может происходить либо без потерь, либо с потерями. Сжатие без потерь можно распаковать, чтобы восстановить цифровые данные в исходную форму. Сжатие обязательно удаляет некоторую информацию во время процедуры декомпрессии и параметризуется, чтобы указать степень толерантности к технике сжатия для удаления данных.

Без потерь

Без потерь сжимаются цифровые аудиозаписи, используя сложные перестановки сохраненных данных, что не приводит к ухудшению качества исходного цифрового образца. При сжатии без потерь при распаковке данных в исходную цифровую форму информация не будет потеряна.

Итак, почему методы сжатия без потерь иногда имеют параметры оптимизации? Эти параметры часто обрабатывают размер файла для времени декомпрессии. Например, FLAC использует параметр уровня сжатия от 0 (самый быстрый) до 8 (наименьший размер файла). Сжатие FLAC более высокого уровня не потеряет никакой информации по сравнению со сжатием более низкого уровня. Вместо этого алгоритму сжатия просто нужно будет затрачивать больше вычислительной энергии при построении или деконструировании оригинального цифрового звука.

API Speech поддерживает два кодирования без потерь: FLAC и LINEAR16. Технически LINEAR16 не является «сжатием без потерь», поскольку в первую очередь не задействовано сжатие. Если размер файла или передача данных важны для вас, выберите FLAC как ваш вариант кодирования звука.

Потеря компрессии

Сжатие аудиоданных устраняет или уменьшает некоторые типы информации при построении сжатых данных. Speech API поддерживает несколько форматов с потерями, хотя их следует избегать, поскольку потеря данных может повлиять на точность распознавания.

Популярный MP3-кодек является примером метода кодирования с потерями. Все методы сжатия MP3 удаляют звук извне обычного аудиодиапазона человека и регулируют уровень сжатия, регулируя эффективную скорость передачи данных кодека MP3 или количество бит в секунду для сохранения даты звука.

Например, стерео CD с использованием линейного PCM из 16 бит имеет эффективную скорость передачи битов. Формула глубины кодирования звука:

441000 * 2 канала * 16 бит = 1411200 бит в секунду (бит/с) = 1411 Кбит/с

Например, сжатие MP3 удаляет такие цифровые данные, используя скорость передачи данных, такие как 320 кбит/с, 128 кбит/с или 96 кбит/с, что приводит к ухудшению качества звука. MP3 также поддерживает переменные скорости передачи битов, которые могут дополнительно сжать аудио. Оба метода теряют информацию и могут влиять на качество. С уверенностью можно сказать, что большинство людей могут определить разницу между кодированной MP3-музыкой 96 кбит/с или 128 Кбит/с.

Другие формы сжатия

MULAW — это 8-битное кодирование PCM, где амплитуда выборки модулируется логарифмически, а не линейно. В результате uLaw уменьшает эффективный динамический диапазон сжатого звука. Хотя uLaw был введен специально для оптимизации кодирования речи в отличие от других типов аудио, 16-битный LINEAR16 (несжатый PCM) по-прежнему намного превосходит 8-битный сжатый звук uLaw.

AMR и AMR_WB модулируют кодированный аудиокасс, вводя переменную скорость передачи битов в исходный звуковой образец.

Хотя Speech API поддерживает несколько форматов с потерями, вам следует избегать их, если у вас есть контроль над исходным аудио. Хотя удаление таких данных посредством сжатия с потерями может не оказывать заметного влияния на звук, слышимый человеческим ухом, потеря таких данных для механизма распознавания речи может значительно ухудшить точность.

Определение объёма памяти, необходимого для хранения графической информации

Различают три вида компьютерной графики:

- растровая графика;

- векторная графика;

- фрактальная графика.

Они различаются принципами формирования изображения при отображении на экране монитора или при печати на бумаге. Наименьшим элементом растрового изображения является точка (пиксель), векторное изображение строится из геометрических примитивов, фрактальная графика задаётся математическими уравнениями.

Расчёт информационного объёма растрового графического изображения основан на подсчёте количества пикселей в этом изображении и на определении глубины цвета (информационного веса одного пикселя).

Глубина цвета зависит от количества цветов в палитре:

N=2i

.

(N) — это количество цветов в палитре,

(i) — глубина цвета (или информационный вес одной точки, измеряется в битах).

Чтобы найти информационный объём растрового графического изображения (I) (измеряется в битах), воспользуемся формулой

I=i⋅k

.

(k) — количество пикселей (точек) в изображении;

(i) — глубина цвета (бит).

Пример:

Полина увлекается компьютерной графикой. Для конкурса она создала рисунок размером (1024*768) пикселей, на диске он занял (900) Кбайт. Найди максимально возможное количество цветов в палитре изображения.

Дано

(k=1024*768);

(I=900) Кбайт.

Найти: (N).

Решение

Чтобы найти (N), необходимо знать (i):

N=2i

.

Из формулы

I=i⋅k

выразим

i=Ik

, подставим числовые значения. Не забудем перевести (I) в биты.

Получим

i=900∗1024∗81024∗768≈9,3

.

Возьмём (i=9) битам. Обрати внимание, нельзя взять (i=10) битам, так как в этом случае объём файла (I) превысит (900) Кбайт. Тогда

N=29=512.

Ответ: (512) цветов.

На качество изображения влияет также разрешение монитора, сканера или принтера.

Разрешение — величина, определяющая количество точек растрового изображения на единицу длины.

Получается, если увеличить разрешение в (3) раза, то увеличится в (3) раза количество пикселей по горизонтали и увеличится в (3) раза количество пикселей по вертикали, т. е. количество пикселей в изображении увеличится в (9) раз.

Параметры PPI и DPI определяют разрешение или чёткость изображения, но каждый относится к отдельным носителям:

• цифровой (монитор) — PPI;

• печать (бумага) — DPI.

При решении задач величины PPI и DPI имеют одинаковый смысл.

При расчётах используется формула

I=k⋅i⋅ppi2

.

(I) — это информационный объём растрового графического изображения (бит);

(k) — количество пикселей (точек) в изображении;

(i) — глубина цвета (бит),

ppi (или dpi) — разрешение.

Пример:

для обучения нейросети распознаванию изображений фотографии сканируются с разрешением (600) ppi и цветовой системой, содержащей (16 777 216) цветов. Методы сжатия изображений не используются. Средний размер отсканированного документа составляет (18) Мбайт. В целях экономии было решено перейти на разрешение (300) ppi и цветовую систему, содержащую (65 536) цветов. Сколько Мбайт будет составлять средний размер документа, отсканированного с изменёнными параметрами?

Решение

Заметим, что

16777216=224

, значит,

i1=24

бита.

, значит,

i2=16

бит.

Воспользуемся формулой

I=k⋅i⋅ppi2

.

I1=24⋅k⋅6002;I2=16⋅k⋅3002;I1I2=24⋅k⋅600216⋅k⋅3002=6;18I2=6;I2=186=3.

Ответ: (3) Мбайта.

Определение объёма памяти, необходимого для хранения звуковой информации

Звук — это распространяющиеся в воздухе, воде или другой среде волны с непрерывно меняющейся амплитудой и частотой.

Чтобы компьютер мог обрабатывать звук, непрерывный звуковой сигнал должен быть преобразован в цифровую дискретную форму. Для этого его подвергают временной дискретизации и квантованию: параметры звукового сигнала измеряются не непрерывно, а через определённые промежутки времени (временная дискретизация); результаты измерений записываются в цифровом виде с ограниченной точностью (квантование).

Сущность временной дискретизации заключается в том, что через равные промежутки времени мы измеряем уровень аналогового сигнала. Количество таких измерений за одну секунду называется частотой дискретизации.

Частота дискретизации ((H)) — это количество измерений громкости звука за одну секунду.

Частота дискретизации измеряется в герцах (Гц) и килогерцах (кГц). (1) кГц (=) (1000) Гц. Частота дискретизации, равная (100) Гц, означает, что за одну секунду проводилось (100) измерений громкости звука.

Качество звукозаписи зависит не только от частоты дискретизации, но также и от глубины кодирования звука.

Глубина кодирования звука или разрешение ((i)) — это количество информации, которое необходимо для кодирования дискретных уровней громкости цифрового звука.

В результате измерений звукового сигнала будет получено некоторое значение громкости, при этом все результаты измерений будут лежать в некотором диапазоне — количество уровней дискретизации.

Обозначим за (N) количество уровней дискретизации, тогда глубину кодирования можно найти по формуле:

N=2i

.

Для решения задач на нахождение объёма памяти, необходимого для хранения звуковой информации, воспользуемся формулой:

I=H⋅i⋅t⋅k

, где

(I) — информационный объём звукового файла (бит);

(H) — частота дискретизации (Гц);

(i) — глубина кодирования информации (бит);

(k) — количество каналов (моно — (1) канал, стерео — (2) канала, квадро — (4) канала).

Пример:

для распределения птиц по категориям обучают нейросеть. Для этого загружают звуки, издаваемые птицами. Каждый файл записан в формате монозвукозаписи с частотой дискретизации (128) Гц. При записи используется (64) уровня дискретизации. Запись длится (6) минут (24) секунды. Определи размер загружаемого файла в килобайтах.

Дано

(k=1);

(H=128) Гц;

(N=64);

(t=384) секунды.

Найти: (I) (Кбайт).

Решение

Воспользуемся формулой

N=2i

, (i=6) бит.

Подставим числовые значения в формулу

I=H⋅i⋅t⋅k

и переведём биты в килобайты:

Ответ: (36) килобайт.

Любой файл может быть передан по каналу связи, тогда объём переданной информации вычисляется по формуле:

I=V⋅t

, где

(I) — объём информации (бит);

(V) — пропускная способность канала связи (бит/секунду);

(t) — время передачи (секунды).

Пример:

в дельте Волги орнитологи оцифровывают звуки птиц и записывают их в виде файлов без использования сжатия данных. Получившийся файл передают в Астраханский биосферный заповедник по каналу связи за (56) секунд. Затем тот же файл оцифровывают повторно с разрешением в (8) раз ниже и частотой дискретизации в (3) раза выше, чем в первый раз. Сжатие данных не производится. Полученный файл передают в Кавказский природный заповедник; пропускная способность канала связи с Кавказским заповедником в (2) раза ниже, чем канала связи с Астраханским заповедником. Сколько секунд длилась передача файла в Кавказский заповедник?

Решение

Воспользуемся формулой

I=H⋅i⋅t⋅k

.

I1=k⋅i⋅t⋅H;I2=k⋅i8⋅t⋅3⋅H;I2I1=38.По условиюV2=V12.

Выразим (V) из формулы

I=V⋅t

, получим

V=It

, учтём, что

t1=56 секунд.Тогда I2t2=I156⋅2;t2=56⋅2⋅I2I1=56⋅2⋅38=42.

Ответ: (42) секунды.

Обрати внимание!

1 Мбайт=220 байт=223 бит.1 Кбайт=210 байт=213 бит.

Кодирование звуковой информации

Звук – это волны, распространяющиеся в твердых телах, жидкостях и газах, вызванные колебаниями частиц среды. Изменения давления акустической волны на препятствия, позволяет слуховому аппарату человека регистрировать звук.

Основными характеристиками любой волны являются частота и амплитуда. Амплитуда акустического сигнала характеризует громкость звука, а частота – тон.

Акустическая волна является непрерывной, поэтому для обработки на компьютере ее необходимо преобразовать в цифровую форму. В ходе кодирования звуковая информация подвергается временной дискретизации и квантованию.

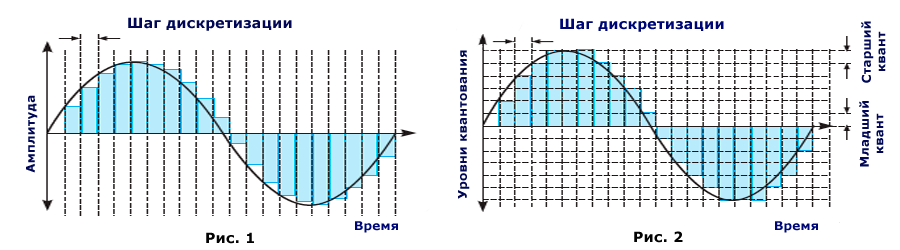

Процесс временной дискретизации заключается в регистрации параметров звука через определённые очень короткие промежутки времени, в пределах которых сигнал считается неизменным (см. рис. 1). Частоту измерения сигнала называют частотой дискретизации.

В течении временной дискретизации непрерывный диапазон значений амплитуды звуковой волны квантуется путем разбиения на дискретную последовательность значений амплитудных уровней (см. рис. 2).

Количество бит, отводимых для записи номеров уровней называется глубиной кодирования звука.

Глубина кодирования звука связана с количеством уровней квантования по формуле:

N = 2 i

где N – количество уровней разбиения амплитуды сигнала,

i – число бит (глубина кодирования), отводимых для кодирования уровней амплитуды сигнала

Чем выше частота дискретизации и глубина кодирования звука, тем точнее цифровое представление оригинального непрерывного звукового сигнала.

Повышая частоту дискретизации и глубину кодирования звука, можно более точно сохранить, а затем восстановить форму оригинального звукового сигнала. Необходимо заметить, что в этом случае увеличивается объем сохраняемого файла. В различных ситуациях при цифровой записи звука используют разные значения частоты дискретизации и глубины кодирования звука.

Для расчета информационного объема звукового файла используется следующая формула:

I = i • ν • t • k

где i – глубина кодирования

ν – частота дискретизации

t — время звучания файла,

k — коэффициент, знaчение которого зависит от качества звука: моно — 1, стерео — 2, квадро — 4