1.7.1. Как найти проекцию вектора на вектор?

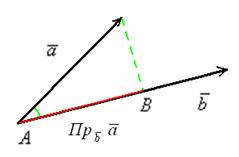

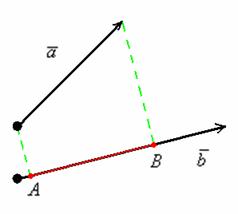

Рассмотрим ненулевые векторы и

:

Спроецируем вектор на вектор

, для этого из начала и конца вектора

опустим перпендикуляры на вектор

(зелёные пунктирные линии).

Представьте,

что на вектор перпендикулярно сверху падают

лучи света. Тогда отрезок будет «тенью»

вектора . Проекцией вектора

на вектор

является ДЛИНА отрезка

. То есть, ПРОЕКЦИЯ – ЭТО ЧИСЛО.

Это ЧИСЛО обозначается следующим образом: , «большим вектором» обозначают вектор КОТОРЫЙ проецируют,

«маленьким подстрочным вектором» обозначают вектор НА который проецируют.

Сама запись читается так: «проекция

вектора «а» на вектор «бэ»».

Если угол между векторами острый (как на рисунке выше), то

Если векторы ортогональны, то

(проекцией является точка, размеры которой считаются нулевыми).

Если угол между векторами тупой (на рисунке мысленно переставьте стрелочку вектора

), то

(та же длина с добавленным знаком «минус»).

Отвечу на назревший вопрос: что произойдёт, если вектор «бэ» будет «слишком коротким»? Проводим прямую линию, содержащую

вектор «бэ». И вектор «а» будет проецироваться уже на направление вектора «бэ», попросту – на прямую, содержащую

вектор «бэ». То же самое произойдёт, если вектор «а» отложить в тридесятом царстве – он всё равно легко спроецируется на

прямую, содержащую вектор «бэ».

Из вышесказанного следует, что проекция вектора на любой ненулевой сонаправленный вектор

будет точно такой же:

– фактически это проекция вектора

на прямую

, которая содержит сонаправленные векторы

(и поскольку векторы свободны, то таких прямых будет

бесконечно много, все они будут параллельны друг другу);

а если векторы направлены противоположно , то

добавится знак «минус»:

Отложим наши подопытные векторы от одной точки:

и рассмотрим прямоугольный треугольник. Косинус угла – есть отношение прилежащего катета к гипотенузе:

, но с другой стороны, у нас уже получена

формула косинуса угла между векторами:

…все ли догадались, что будет дальше?

Приравниваем формулы:

и сокращаем знаменатели обеих частей на ,

получая формулу для вычисления проекции:

Распишем её в координатах:

Если векторы плоскости и

заданы в ортонормированном базисе

, то проекция вектора

на вектор

выражается формулой:

Если векторы пространства заданы в ортонормированном базисе

, то проекция вектора

на вектор

выражается формулой:

Легко убедиться, что проекция вектора на

коллинеарный вектор может

отличаться лишь знАком, приведу выкладки для «плоского» случая :

, если

, и

, если

Задача 34

Найти проекцию вектора на вектор

Решение в одну строчку:

знаменатель на , избавившись тем самым от

иррациональности в знаменателе.

Ответ:

Проекция – это ДЛИНА, поэтому обязательно указываем размерность, правда, если получится знак «минус», то смотреться это

будет своеобразно.

Задача 35

Треугольник задан своими вершинами .

Найти:

а) проекцию стороны на сторону

;

б) проекцию стороны на сторону

.

Это задача для самостоятельного решения.

Итак, как найти проекцию вектора на отрезок с известными концами

? (как вариант, на продолжение этого отрезка). Находим вектор

и используем формулу

и формулу

одном из случаев получится отрицательное значение, и если оно вас напрягает, выберите другой вариант

О проекции же вектора на прямую поговорим в следующей главе, а пока

выясним геометрический смысл координат векторов в ортонормированном базисе:

| Оглавление |

Автор: Aлeксaндр Eмeлин

Угол между векторами. Ортогональные проекции векторов

Угол между векторами

Углом между двумя ненулевыми векторами называется угол между равными им векторами, имеющими общее начало, не превосходящий по величине числа .

Пусть в пространстве даны два ненулевых вектора и

(рис.1.22). Построим равные им векторы

и

. На плоскости, содержащей лучи

и

, получим два угла

. Меньший из них, величина

которого не превосходит

, принимается за угол между векторами

и

.

Поскольку направление нулевого вектора не определено, то не определен и угол между двумя векторами, если хотя бы один из них нулевой. Из определения следует, например, что угол между ненулевыми коллинеарными векторами либо равен нулю (если векторы одинаково направлены), либо равен (если векторы противоположно направлены).

Ортогональные проекции векторов

Движение по любой прямой может быть в двух направлениях. Ориентированной прямой называется прямая, на которой выбрано направление, т.е. одно из направлений считается положительным, а противоположное — отрицательным. Для измерения длин отрезков на прямой задается масштабный отрезок, который принимается за единицу.

Ориентированная прямая с заданным масштабным отрезком называется осью.

Любой ненулевой вектор , принадлежащий прямой, называется направляющим вектором для данной прямой, поскольку задает на ней ориентацию. Направление вектора

принимается за положительное, а направление противоположного вектора

— за отрицательное. Кроме того, длину вектора

— можно принять за величину масштабного отрезка на этой прямой. Поэтому можно сказать, что любой ненулевой вектор определяет ось — прямую, содержащую этот вектор, задавая на ней направление и масштабный отрезок.

Ортогональной проекцией вектора на ось, задаваемую вектором

, называется его проекция на ось вдоль прямой (или вдоль плоскости), перпендикулярной данной оси. Ортогональную проекцию вектора

на ось, задаваемую вектором

, будем обозначать

.

Ортогональную проекцию вектора на прямую

(см. разд. 1.2.2 и рис. 1.13) будем обозначать

.

Ортогональную проекцию вектора а на плоскость (см. разд. 1.2.2 и рис. 1.14) будем обозначать

.

Разность между вектором и его ортогональной проекцией называют ортогональной составляющей:

— — ортогональная составляющая вектора

относительно вектора

;

— — ортогональная составляющая вектора

относительно прямой

;

— — ортогональная составляющая вектора

относительно плоскости

.

На рис. 1.23 изображены ортогональные проекции вектора :

— на прямую (или на ось

, задаваемую вектором

) вдоль прямой

(рис.1.23,а);

— на прямую (или на ось

, задаваемую вектором

) вдоль плоскости

(рис.1.23,б);

— на плоскость вдоль прямой

(рис.1.23,в).

На рис. 1.23 изображены ортогональные составляющие вектора :

— относительно оси (вектора

):

(рис.1.23,а);

— относительно плоскости (рис.1.23,в).

Для ортогональных проекций справедлива следующая теорема (см. теорему 1.1 в разд. 1.5).

Теорема 1.2 (об ортогональных проекциях вектора).

1. Если на плоскости заданы две взаимно перпендикулярные прямые и

, то любой вектор

на плоскости можно однозначно представить в виде суммы своих ортогональных проекций на эти прямые, т.е.

(рис. 1.24,а).

2. Если в пространстве заданы три попарно перпендикулярные прямые и

, пересекающиеся в одной точке, то любой вектор

в пространстве можно однозначно представить в виде суммы своих ортогональных проекций на эти прямые, т.е.

(рис. 1.24,6).

3. Квадрат длины вектора на плоскости или в пространстве равен сумме квадратов длин своих ортогональных проекций, т.е.

Первые два утверждения представляют собой частные случаи теоремы 1.1. Третье утверждение следует из теоремы Пифагора (для треугольника (рис. 1.24,а) или треугольников

и

(рис. 1.24,6)).

В формулировке теоремы 1.2 прямые можно заменить осями, задаваемыми попарно ортогональными векторами.

На рис.1.24,а проекции вектора на оси одновременно являются ортогональными составляющими:

и

. На рис. 1.24,6 вектор

является проекцией вектора

на плоскость

, содержащую прямые

и

:

, а вектор

является ортогональной составляющей вектора

относительно плоскости

.

Алгебраическое значение длины проекции

Пусть – угол между ненулевым вектором

и осью, задаваемой вектором

, т.е. угол между ненулевыми векторами

и

.

Алгебраическим значением длины ортогональной проекции вектора на ось, задаваемую вектором

, называется длина его ортогональной проекции

, взятая с положительным знаком, если угол

не превышает

, и с отрицательным знаком, если угол

больше

, т.е.:

Например, для проекций, изображенных на рис. 1.25, , поскольку угол

между векторами

и

острый, a

, так как угол

между векторами

и

тупой.

Некоторые свойства проекций векторов переносятся на алгебраические значения их длин, в частности:

1. — алгебраическое значение длины ортогональной проекции суммы векторов равно сумме алгебраических значений длин ортогональных проекций слагаемых;

2. — алгебраическое значение длины ортогональной проекции произведения вектора на число равно произведению этого числа на алгебраическое значение длины ортогональной проекции вектора

Замечания 1.4.

1. Из определения алгебраического значения длины ортогональной проекции следует (см. также рис.1.25), что , т.е. алгебраическое значение длины ортогональной проекции ненулевого вектора на ось равна произведению длины этого вектора на косинус угла между вектором и осью.

Ортогональную проекцию вектора на ось, задаваемую вектором

, можно представить в виде

Если — единичный вектор, то

.

2. Равенство можно использовать как определение косинуса угла между ненулевыми векторами

и

(или, что то же самое, косинуса угла между осями, заданными ненулевыми векторами

и

(рис. 1.26)).

3. Углом между ненулевым вектором и прямой

называется угол

между вектором

и его ортогональной проекцией

на прямую

. Величина угла

может быть найдена по формуле

4. Углом между ненулевым вектором и плоскостью

называется угол

между вектором

и его ортогональной проекцией

на плоскость

. Величина угла

может быть найдена по формуле

Пример 1.7. Основания и

равнобокой трапеции

равны

и

соответственно; точка

— середина стороны

(рис. 1.27). Найти алгебраические значения длин ортогональных проекций векторов

и

на ось, задаваемую вектором

.

Решение. Пусть — высота трапеции,

— точка пересечения прямых

и

. По свойству равнобокой трапеции

; из равенства треугольников

и

.

Обозначим через искомые алгебраические значения длин ортогональных проекций.Тогда из равенств

,

и свойства 1 алгебраических значений длин проекций следует:

Решая систему находим

, т.е.

.

Математический форум (помощь с решением задач, обсуждение вопросов по математике).

Если заметили ошибку, опечатку или есть предложения, напишите в комментариях.

Проекция вектора на вектор

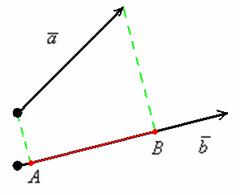

Рассмотрим

векторы

и

:

Спроецируем

вектор

на

вектор

,

для этого из начала и конца вектора

опустим

перпендикуляры на

вектор

(пунктирные

линии). В данном случае проекцией

вектора

на

вектор

является

ДЛИНА отрезка

.

То есть, ПРОЕКЦИЯ – ЭТО ЧИСЛО.

Данное

ЧИСЛО обозначается следующим образом:

,

«большим вектором» обозначают

вектор, КОТОРЫЙ проецируют,

«маленьким подстрочным вектором»

обозначают вектор НА

который проецируют.

Сама

запись

читается

так: «проекция вектора «а» на вектор

«бэ»».

Что

произойдёт, если вектор «бэ» будет

«слишком коротким»? Проводим прямую

линию, содержащую вектор «бэ». И вектор

«а» будет проецироваться уже на

направление вектора «бэ»,

попросту – на прямую, содержащую вектор

«бэ». То же самое произойдёт, если вектор

«а» отложить в тридесятом царстве – он

всё равно легко спроецируется на прямую,

содержащую вектор «бэ».

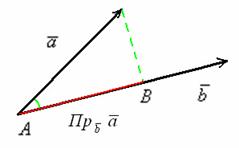

Если

угол между

векторами

острый (как

на рисунке), то

Если

векторы

ортогональны,

то

(проекцией

является точка, размеры которой считаются

нулевыми).

Если

угол между

векторами

тупой (на

рисунке мысленно переставьте стрелочку

вектора

),

то

(та

же длина, но взятая со знаком минус).

Отложим

данные векторы от одной точки:

Очевидно,

что при перемещении вектора его проекция

не меняется

Рассмотрим

прямоугольный треугольник. Косинусом

острого угла называется отношение

прилежащего катета к гипотенузе. В

данном случае:

С

другой стороны, у нас уже получена

формула косинуса угла между векторами:

Таким

образом:

Сокращаем

знаменатели обеих частей на

и

получаем формулу для вычисления

проекции:

Формула

выведена, распишем её в координатах:

Если

векторы плоскости

и

,

заданы в ортонормированном базисе

,

то проекция вектора

на

вектор

выражается

формулой:

.

Если

векторы пространства

,

заданы в ортонормированном базисе

,

то проекция вектора

на

вектор

выражается

формулой:

Пример

Найти

проекцию вектора

на

вектор

Решение:

Ответ:

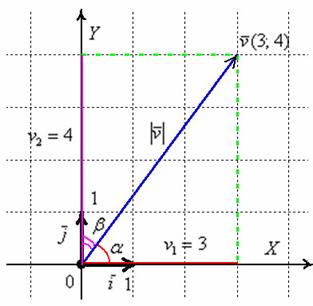

Проекция вектора на координатные оси. Направляющие косинусы вектора

Рассмотрим

вектор плоскости

,

заданный своими координатами в

ортонормированном базисе

.

Проекцией

вектора

на

координатную ось

является

в точности его первая координата:

.

Обозначим через

угол

между вектором

и

координатным вектором

:

.

Тогда:

(определение

косинуса в прямоугольном треугольнике

недавно упоминалось).

Аналогично

со второй координатой: проекцией

вектора

на

координатную ось

является

его вторая координата:

.

Обозначим через

угол

между вектором

и

координатным вектором

:

.

Тогда:

Косинусы

называются направляющими

косинусами вектора.

Причём, для любого ненулевого вектора

справедливо равенство

.

Проверим его справедливость для

рассматриваемого вектора:

,

что и требовалось проверить.

Заметьте,

что приведённые выше выкладки не

изменятся, если вектор

отложить

от любой другой точки плоскости.

Координаты

вектора в ортонормированном базисе –

это его проекции на направления

соответствующих координатных векторов

(координатные оси).

Направляющие

косинусы ненулевого

вектора

,

заданного в ортонормированном

базисе

, выражаются

формулами

,

а сами координаты вектора можно выразить

через его длину и данные косинусы:

,

то есть:

.

С

пространственными векторами, заданными

в ортонормированном базисе

,

разборки точно такие же. Рассмотрим

произвольный ненулевой вектор

.

Его координаты представляют собой

проекции вектора на оси

соответственно.

Обозначим углы данного вектора с ортами

через:

.

Тогда направляющие

косинусы вектора выражаются формулами:

,

и справедливым является равенство

.

Пример

Найти

направляющие косинусы векторов:

а)

,

проверить, что

;

б)

,

проверить, что

.

Решение:

а)

Найдём длину вектора:

.

Направляющие

косинусы:

.

Проверка:

,

что и требовалось проверить.

б)

Найдём длину вектора:

.

Направляющие

косинусы:

.

Проверка:

,

что и требовалось проверить.

Ответ:

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

«Orthogonal projection» redirects here. For the technical drawing concept, see Orthographic projection. For a concrete discussion of orthogonal projections in finite-dimensional linear spaces, see Vector projection.

The transformation P is the orthogonal projection onto the line m.

In linear algebra and functional analysis, a projection is a linear transformation

Definitions[edit]

A projection on a vector space

When

Projection matrix[edit]

The eigenvalues of a projection matrix must be 0 or 1.

Examples[edit]

Orthogonal projection[edit]

For example, the function which maps the point

The action of this matrix on an arbitrary vector is

To see that

Observing that

Oblique projection[edit]

A simple example of a non-orthogonal (oblique) projection is

Via matrix multiplication, one sees that

showing that

The projection

Properties and classification[edit]

The transformation T is the projection along k onto m. The range of T is m and the kernel is k.

Idempotence[edit]

By definition, a projection

Open map[edit]

Every projection is an open map, meaning that it maps each open set in the domain to an open set in the subspace topology of the image.[citation needed] That is, for any vector

Complementarity of image and kernel[edit]

Let

is the identity operator

on

:

- We have a direct sum

. Every vector

may be decomposed uniquely as

with

and

, and where

The image and kernel of a projection are complementary, as are

Spectrum[edit]

In infinite-dimensional vector spaces, the spectrum of a projection is contained in

Only 0 or 1 can be an eigenvalue of a projection. This implies that an orthogonal projection

If a projection is nontrivial it has minimal polynomial

Product of projections[edit]

The product of projections is not in general a projection, even if they are orthogonal. If two projections commute then their product is a projection, but the converse is false: the product of two non-commuting projections may be a projection.

If two orthogonal projections commute then their product is an orthogonal projection. If the product of two orthogonal projections is an orthogonal projection, then the two orthogonal projections commute (more generally: two self-adjoint endomorphisms commute if and only if their product is self-adjoint).

Orthogonal projections[edit]

When the vector space

A projection is orthogonal if and only if it is self-adjoint. Using the self-adjoint and idempotent properties of

where

for every

Properties and special cases[edit]

An orthogonal projection is a bounded operator. This is because for every

Thus

For finite-dimensional complex or real vector spaces, the standard inner product can be substituted for

Formulas[edit]

A simple case occurs when the orthogonal projection is onto a line. If

(If

by the properties of the dot product of parallel and perpendicular vectors.

This formula can be generalized to orthogonal projections on a subspace of arbitrary dimension. Let

which can be rewritten as

The matrix

The orthonormality condition can also be dropped. If

The matrix

In the general case, we can have an arbitrary positive definite matrix

When the range space of the projection is generated by a frame (i.e. the number of generators is greater than its dimension), the formula for the projection takes the form:

If

If the orthogonal condition is enhanced to

All these formulas also hold for complex inner product spaces, provided that the conjugate transpose is used instead of the transpose. Further details on sums of projectors can be found in Banerjee and Roy (2014).[9] Also see Banerjee (2004)[10] for application of sums of projectors in basic spherical trigonometry.

Oblique projections[edit]

The term oblique projections is sometimes used to refer to non-orthogonal projections. These projections are also used to represent spatial figures in two-dimensional drawings (see oblique projection), though not as frequently as orthogonal projections. Whereas calculating the fitted value of an ordinary least squares regression requires an orthogonal projection, calculating the fitted value of an instrumental variables regression requires an oblique projection.

A projection is defined by its kernel and the basis vectors used to characterize its range (which is a complement of the kernel). When these basis vectors are orthogonal to the kernel, then the projection is an orthogonal projection. When these basis vectors are not orthogonal to the kernel, the projection is an oblique projection, or just a projection.

A matrix representation formula for a nonzero projection operator[edit]

Let

This expression generalizes the formula for orthogonal projections given above.[11][12] A standard proof of this expression is the following. For any vector

In the case that

Singular values[edit]

Note that

and the singular values for

This implies that the largest singular values of

However, the condition number satisfies the relation

Finding projection with an inner product[edit]

Let

where repeated indices are summed over (Einstein sum notation). The vector

y is being projected onto the vector space V.

Canonical forms[edit]

Any projection

where

where

Projections on normed vector spaces[edit]

When the underlying vector space

Many of the algebraic results discussed above survive the passage to this context. A given direct sum decomposition of

However, in contrast to the finite-dimensional case, projections need not be continuous in general. If a subspace

The converse holds also, with an additional assumption. Suppose

The above argument makes use of the assumption that both

Applications and further considerations[edit]

Projections (orthogonal and otherwise) play a major role in algorithms for certain linear algebra problems:

- QR decomposition (see Householder transformation and Gram–Schmidt decomposition);

- Singular value decomposition

- Reduction to Hessenberg form (the first step in many eigenvalue algorithms)

- Linear regression

- Projective elements of matrix algebras are used in the construction of certain K-groups in Operator K-theory

As stated above, projections are a special case of idempotents. Analytically, orthogonal projections are non-commutative generalizations of characteristic functions. Idempotents are used in classifying, for instance, semisimple algebras, while measure theory begins with considering characteristic functions of measurable sets. Therefore, as one can imagine, projections are very often encountered in the context of operator algebras. In particular, a von Neumann algebra is generated by its complete lattice of projections.

Generalizations[edit]

More generally, given a map between normed vector spaces

See also[edit]

- Centering matrix, which is an example of a projection matrix.

- Dykstra’s projection algorithm to compute the projection onto an intersection of sets

- Invariant subspace

- Least-squares spectral analysis

- Orthogonalization

- Properties of trace

Notes[edit]

- ^ Meyer, pp 386+387

- ^ a b Horn, Roger A.; Johnson, Charles R. (2013). Matrix Analysis, second edition. Cambridge University Press. ISBN 9780521839402.

- ^ Meyer, p. 433

- ^ Meyer, p. 431

- ^ Meyer, equation (5.13.4)

- ^ Banerjee, Sudipto; Roy, Anindya (2014), Linear Algebra and Matrix Analysis for Statistics, Texts in Statistical Science (1st ed.), Chapman and Hall/CRC, ISBN 978-1420095388

- ^ Meyer, equation (5.13.3)

- ^ See also Linear least squares (mathematics) § Properties of the least-squares estimators.

- ^ Banerjee, Sudipto; Roy, Anindya (2014), Linear Algebra and Matrix Analysis for Statistics, Texts in Statistical Science (1st ed.), Chapman and Hall/CRC, ISBN 978-1420095388

- ^ Banerjee, Sudipto (2004), «Revisiting Spherical Trigonometry with Orthogonal Projectors», The College Mathematics Journal, 35 (5): 375–381, doi:10.1080/07468342.2004.11922099, S2CID 122277398

- ^ Banerjee, Sudipto; Roy, Anindya (2014), Linear Algebra and Matrix Analysis for Statistics, Texts in Statistical Science (1st ed.), Chapman and Hall/CRC, ISBN 978-1420095388

- ^ Meyer, equation (7.10.39)

- ^ Brust, J. J.; Marcia, R. F.; Petra, C. G. (2020), «Computationally Efficient Decompositions of Oblique Projection Matrices», SIAM Journal on Matrix Analysis and Applications, 41 (2): 852–870, doi:10.1137/19M1288115, OSTI 1680061, S2CID 219921214

- ^ Doković, D. Ž. (August 1991). «Unitary similarity of projectors». Aequationes Mathematicae. 42 (1): 220–224. doi:10.1007/BF01818492. S2CID 122704926.

References[edit]

- Banerjee, Sudipto; Roy, Anindya (2014), Linear Algebra and Matrix Analysis for Statistics, Texts in Statistical Science (1st ed.), Chapman and Hall/CRC, ISBN 978-1420095388

- Dunford, N.; Schwartz, J. T. (1958). Linear Operators, Part I: General Theory. Interscience.

- Meyer, Carl D. (2000). Matrix Analysis and Applied Linear Algebra. Society for Industrial and Applied Mathematics. ISBN 978-0-89871-454-8.

External links[edit]

- MIT Linear Algebra Lecture on Projection Matrices on YouTube, from MIT OpenCourseWare

- Linear Algebra 15d: The Projection Transformation on YouTube, by Pavel Grinfeld.

- Planar Geometric Projections Tutorial – a simple-to-follow tutorial explaining the different types of planar geometric projections.

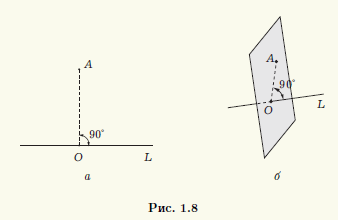

Пусть на плоскости заданы прямая L и точка A. Опустим из точки A на прямую L перпендикуляр (рис. 1.8, а). Тогда его основание (точку O) называют ортогональной проекцией точки A на прямую L. Если прямая L и точка A заданы в пространстве, то в этом случае ортогональной проекцией точки A на прямую L называют точку O пересечения прямой L с перпендикулярной ей плоскостью, проходящей через точку A (рис. 1.8, б). Если точка A лежит на прямой L, то она совпадает со своей ортогональной проекцией на L.

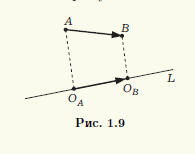

Для вектора — AB (на плоскости или в пространстве) можно построить ортогональные проекции на прямую L его начала и конца (рис. 1.9). Вектор OAOB, соединяющий эти проекции OA и OB и лежащий на прямой L, называют ортогональной проекцией вектора AB на прямую L.

Прямую, на которой задано одно из двух возможных направлений, называют осью. Выбранное направление на оси изображают с помощью стрелки на соответствующем конце оси. Ортогональную проекцию OAOB вектора AB на ось l можно полностью описать длиной вектора OAOB, приписав ей знак,

указывающий направление вектора. Если направление OAOB совпадает с заданным направлением оси, то берут знак плюс, а если направление вектора противоположно направлению оси, то берут знак минус. Длину вектора OAOB со знаком, определяющим направление этого вектора, называют ортогональной проекцией вектора AB на ось l и обозначают прlа.

Обратим внимание на то, что ортогональной проекцией вектора на ось является число, в то время как ортогональная проекция вектора на прямую — это вектор. Чтобы вектору соответствовало число как его проекция, на прямой нужно выбрать одно из двух возможных направлений.

Каждый ненулевой вектор l однозначно определяет ось: его можно рассматривать расположенным на некоторой прямой и задающим на ней направление. Ортогональную проекцию вектора на такую ось называют ортогональной проекцией этого вектора на направление вектора l.

Угол между направлениями двух ненулевых векторов называют углом между этими векторами. Угол может изменяться в пределах от 0 до π. Крайние значения 0 и π отвечают коллинеарным векторам, соответственно однонаправленным и противоположно направленным. Если хотя бы один из двух векторов является нулевым, то угол между такими векторами не определен. Удобно, однако, считать, что в этом случае угол имеет произвольное значение. Так, нулевой вектор коллинеарен любому другому, что формально соответствует углу 0 (или π). Конкретное значение, приписываемое углу между нулевым вектором и каким-либо другим, выбирают исходя из ситуации.

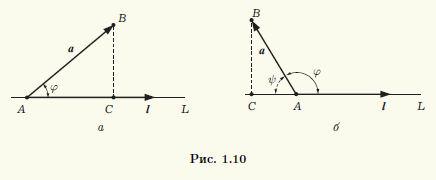

Теорема 1.1. Ортогональная проекция вектора а на направление ненулевого вектора l равна длине |а|, умноженной на косинус угла φ между векторами а и l, т.е.

прl = а|а| cos

где

◄ Пусть вектор l лежит на прямой L, а его началом является точка A. Совместим начало вектора а с точкой A, и пусть его концом будет точка B (рис. 1.10). Построим ортогональную проекцию C точки B на прямую L. Тогда вектор AC является ортогональной проекцией вектора а = AB на прямую L.

Если угол φ между векторами а и l острый (как это показано на рис. 1.10, а), то конец вектора l и точка C лежат по одну сторону от точки A. В этом случае проекция а на направление вектора l равна длине |AC| = |AB| cosφ катета AC треугольника ABC.

Если угол φ тупой (см. рис. 1.10, б), то конец вектора l и точка C лежат по разные стороны от точки A. Это значит, что векторы AC и l имеют противоположные направления, а проекция вектора а равна — |AC|. В треугольнике ABC угол ψ, прилежащий к катету AC, равен π — φ, поэтому |AC| = |AB| cos( π — φ) = — |AB| cosφ.

Если же φ = π/2 или а = 0, то точка C совпадает с точкой A и вектор AC является нулевым вектором. Однако cosπ/2 = 0, следовательно, и в этом случае утверждение теоремы справедливо. ►

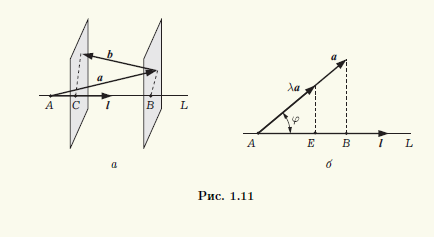

Теорема 1.2. Ортогональная проекция суммы векторов на направление ненулевого вектора равна сумме их ортогональных проекций на направление этого вектора, а при умножении вектора на число его ортогональная проекция на направление ненулевого вектора умножается на то же число:

прl(а + b) = прlа + прlb, прl(λа) — λпрlа.

◄ Доказательство следует из рис. 1.11. В случае, изображенном на рис. 1.11, а, имеем прlа = |AB|, прlb = -|BC|, прl(а + b) = |AC| = |AB| — |BC|. В случае, изображенном на рис. 1.11, б, прlа = |AB| и, если λ > 0, прl(λа) = |AE| = λ|AB|. Остальные варианты (точка C не принадлежит отрезку AB в случае а, λ ≤ 0 в случае б) рассматриваются аналогично. ►

![{displaystyle {begin{aligned}I&={begin{bmatrix}A&Bend{bmatrix}}{begin{bmatrix}A&Bend{bmatrix}}^{-1}{begin{bmatrix}A^{mathsf {T}}\B^{mathsf {T}}end{bmatrix}}^{-1}{begin{bmatrix}A^{mathsf {T}}\B^{mathsf {T}}end{bmatrix}}\&={begin{bmatrix}A&Bend{bmatrix}}left({begin{bmatrix}A^{mathsf {T}}\B^{mathsf {T}}end{bmatrix}}{begin{bmatrix}A&Bend{bmatrix}}right)^{-1}{begin{bmatrix}A^{mathsf {T}}\B^{mathsf {T}}end{bmatrix}}\&={begin{bmatrix}A&Bend{bmatrix}}{begin{bmatrix}A^{mathsf {T}}A&O\O&B^{mathsf {T}}Bend{bmatrix}}^{-1}{begin{bmatrix}A^{mathsf {T}}\B^{mathsf {T}}end{bmatrix}}\[4pt]&=Aleft(A^{mathsf {T}}Aright)^{-1}A^{mathsf {T}}+Bleft(B^{mathsf {T}}Bright)^{-1}B^{mathsf {T}}end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0d5ac3d05451825c162acf531a9416503f4a580e)